这是一个创建于 193 天前的主题,其中的信息可能已经有所发展或是发生改变。

最近看了太多对 Apple Intelligence 架构的猜测,包括 v2 里各种帖子、各种舅舅传言以及各路评测的猜测跟推测,在此之中很多的推测跟苹果自己公布过的架构有较大冲突,也解释不了为何 HK 商店有 Apple Intelligence 但是没有 ChatGPT 的介绍。

这篇文章是我根据苹果官方公布的架构做的一个简单总结和个人推测,如果有误,只能说明我的阅读理解水平不如 GPT 。

Disclaimer: 我并不了解如果苹果的基础模型审核通过需要什么努力跟准备,本文只会讨论技术和可行性。

TL;DR

端上自研小模型(简单工作)+ 远端自研大模型(复杂工作)+ 外部模型(专家,比如 ChatGPT )= Apple Intelligence

架构

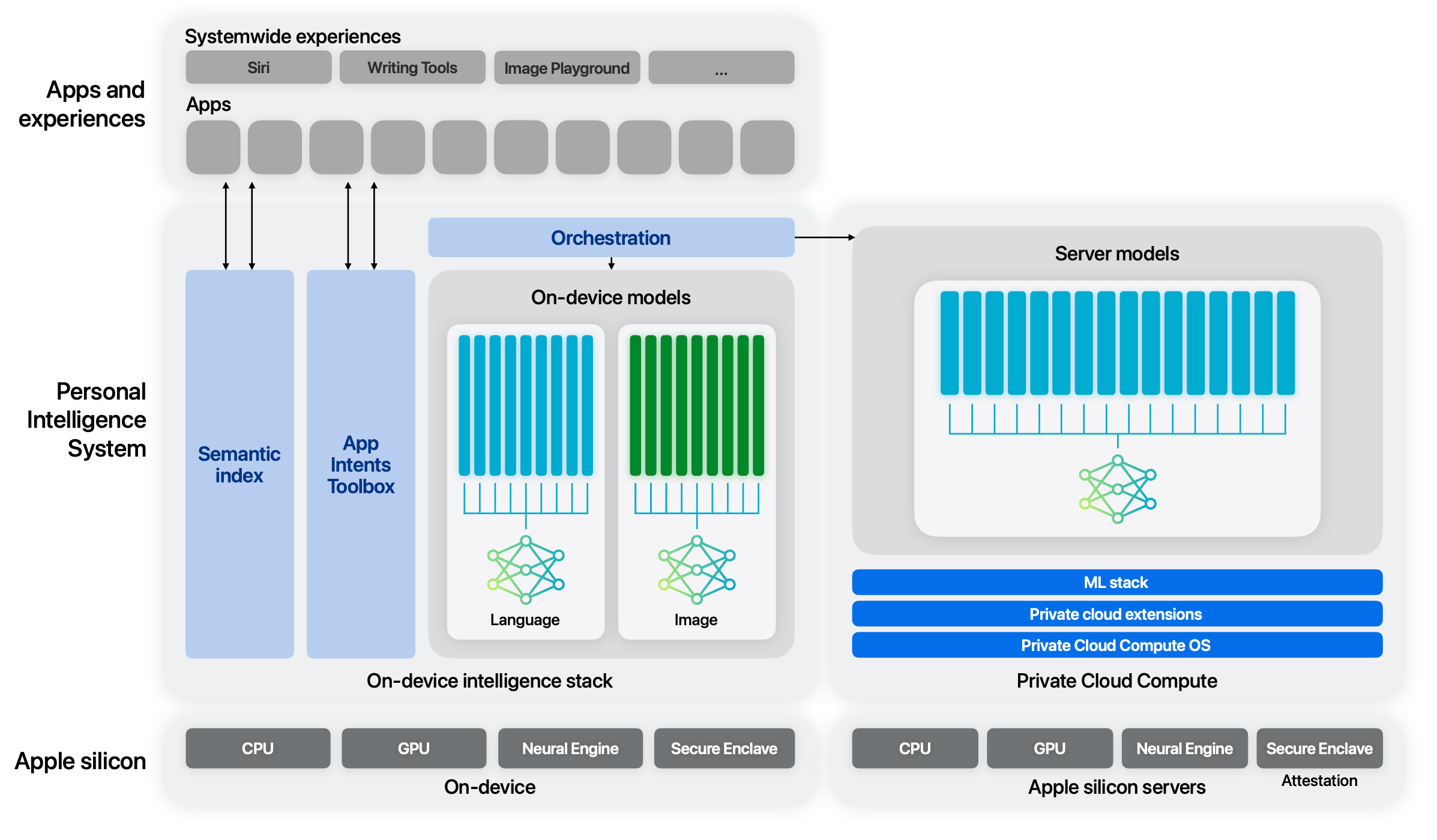

- 外部 App 因为接入 ios/macos API ,底层能力可以直接输出到系统(参考 Shareplay )

- Semantic Index 负责充当知识库,App Intents Toolbox 充当 Tools

- 端上有一个 Orchestration 模块负责将用户请求路由到端上小模型或者远端大模型

- 底层的硬件统一自研芯片 Apple Silicon ,直接复用在硬件上的优势(神经引擎、安全区 etc )

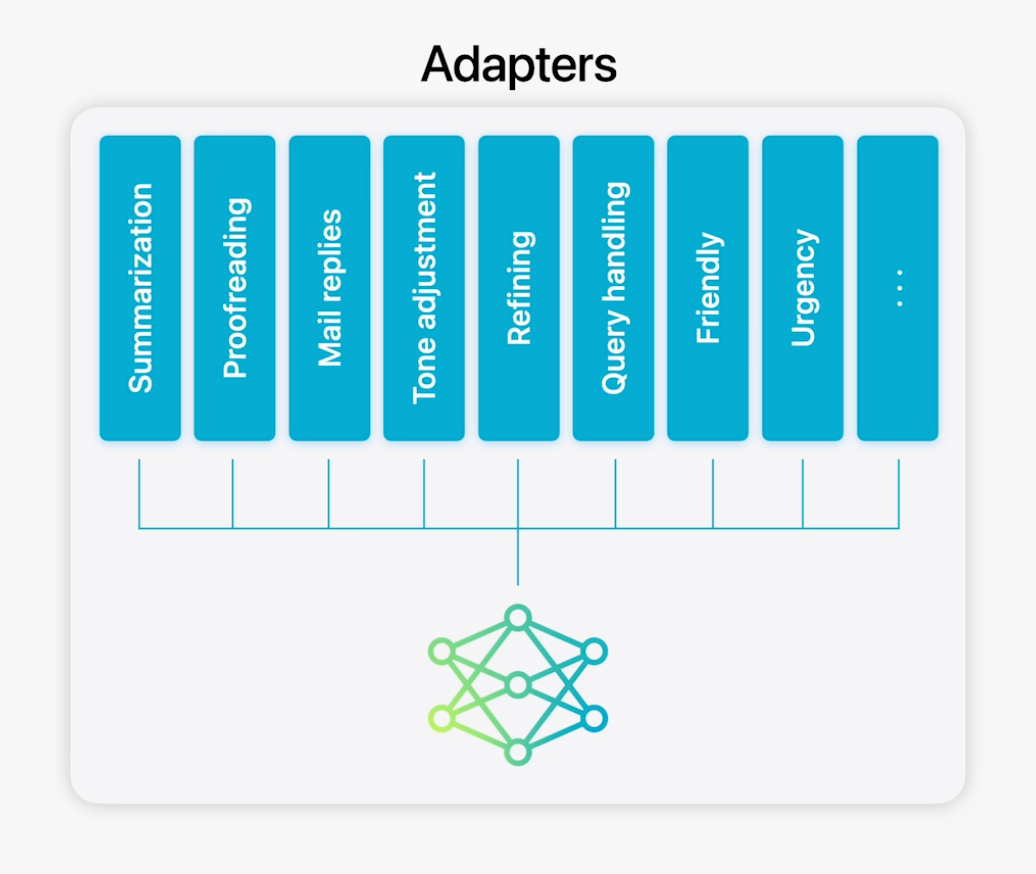

- 预估层面,大量使用 LoRA 做任务相关的 fine-tune 。每个 adapter 大概在 10x M 上下,端上支持动态加载、缓存、切换。

效果评测

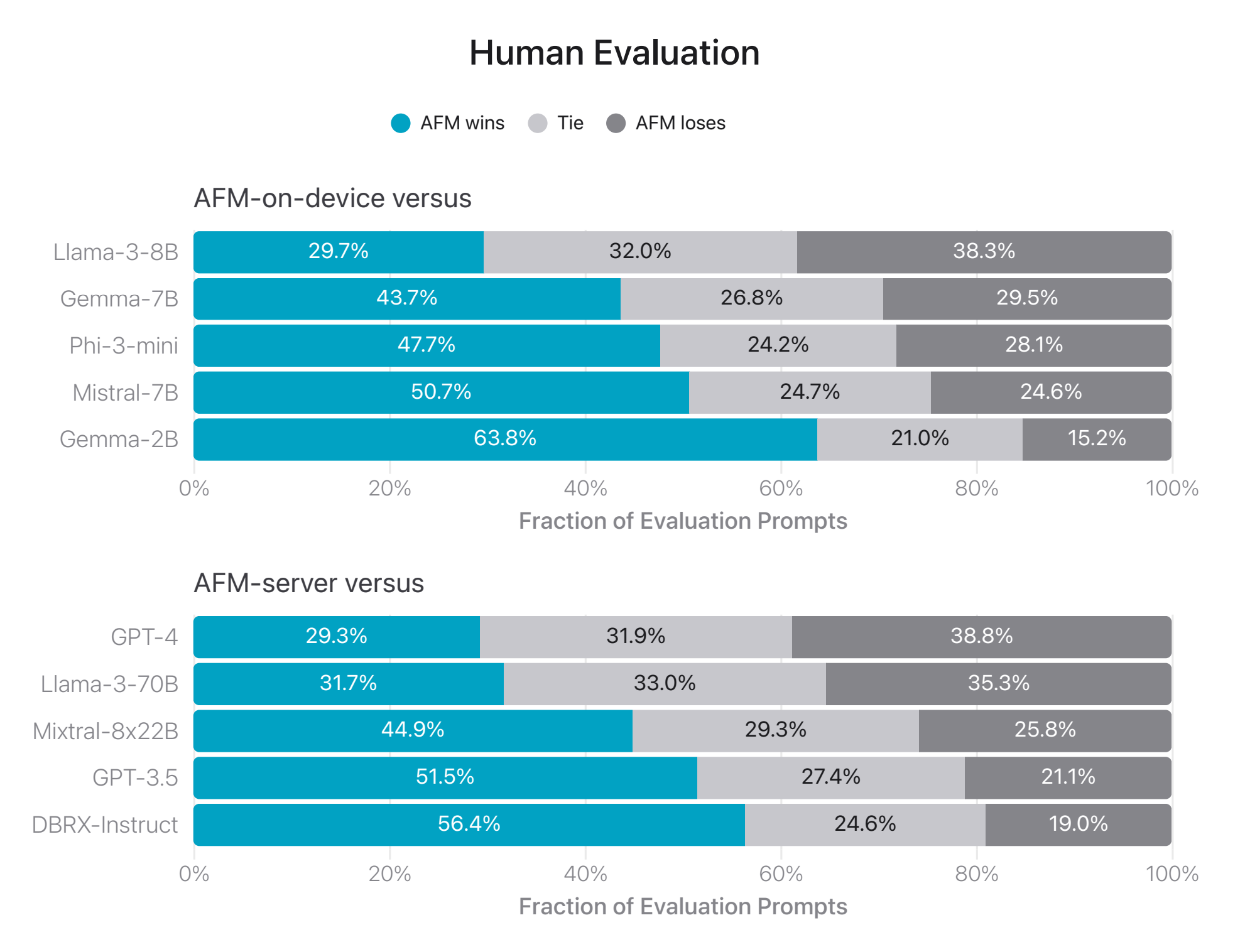

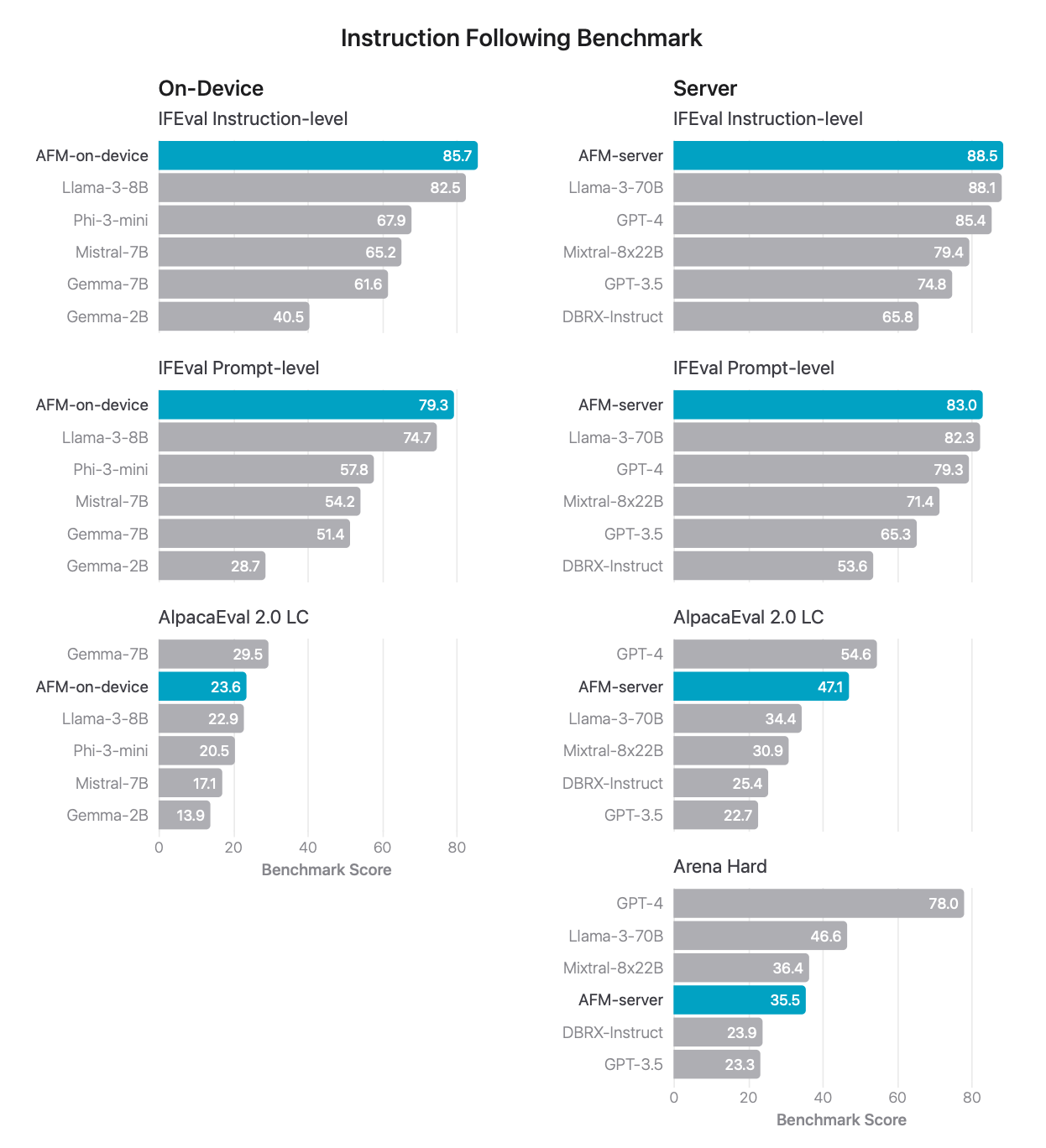

- 整体效果并不亮眼,甚至不一定能打过 Llama3

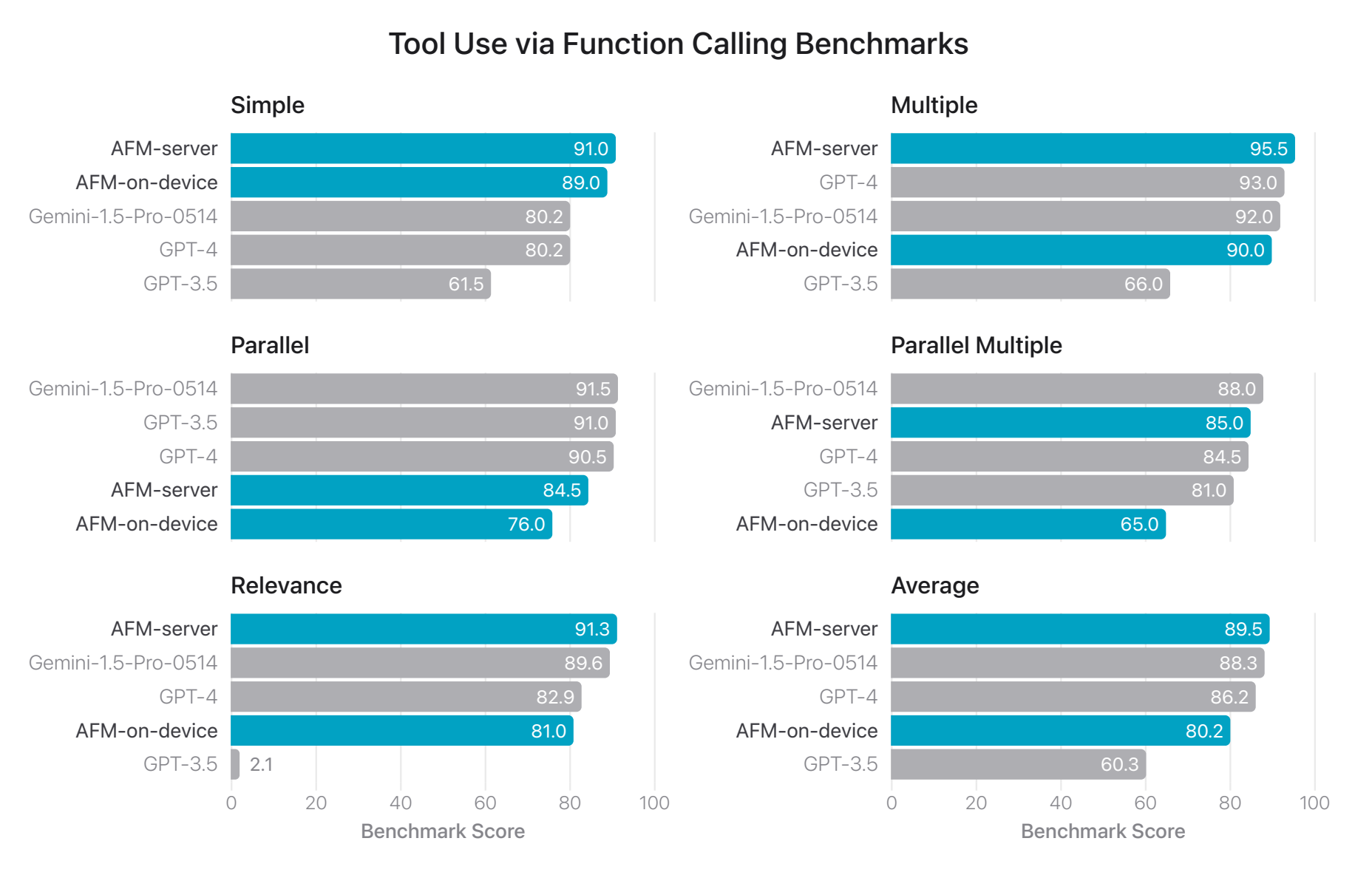

- 在跟随指示跟工具调用上效果较好

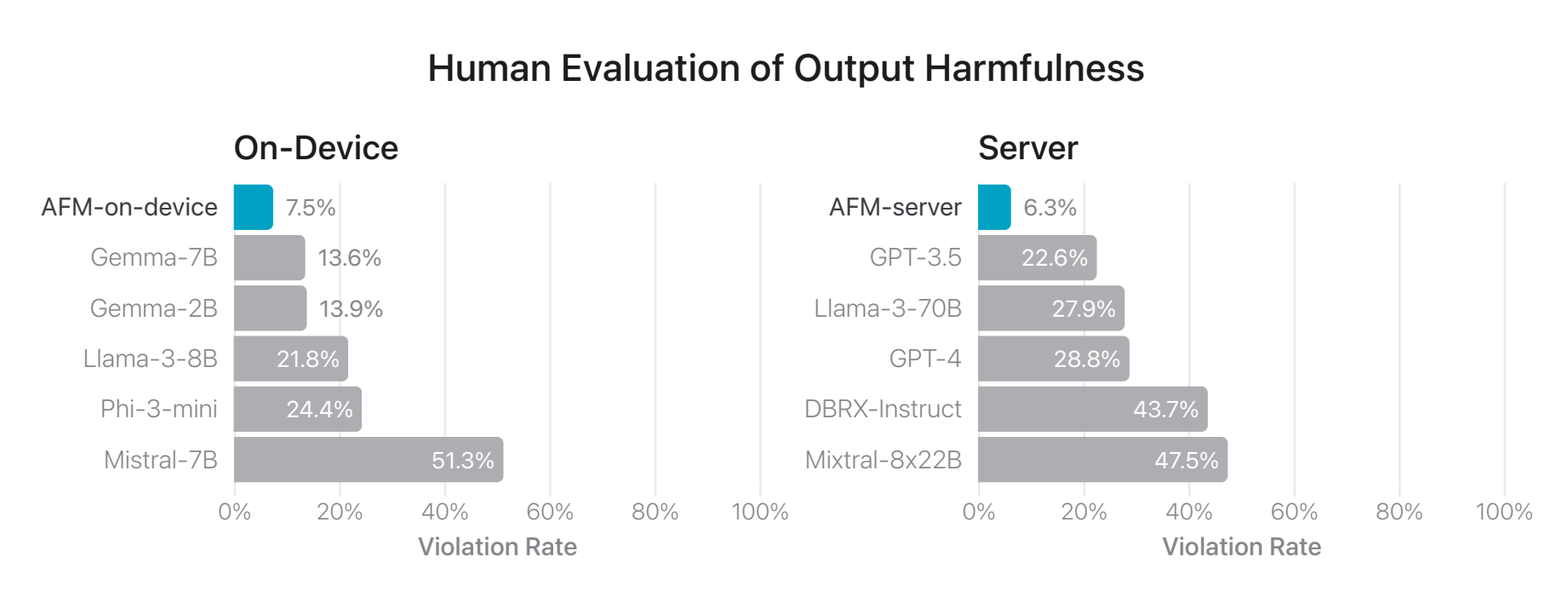

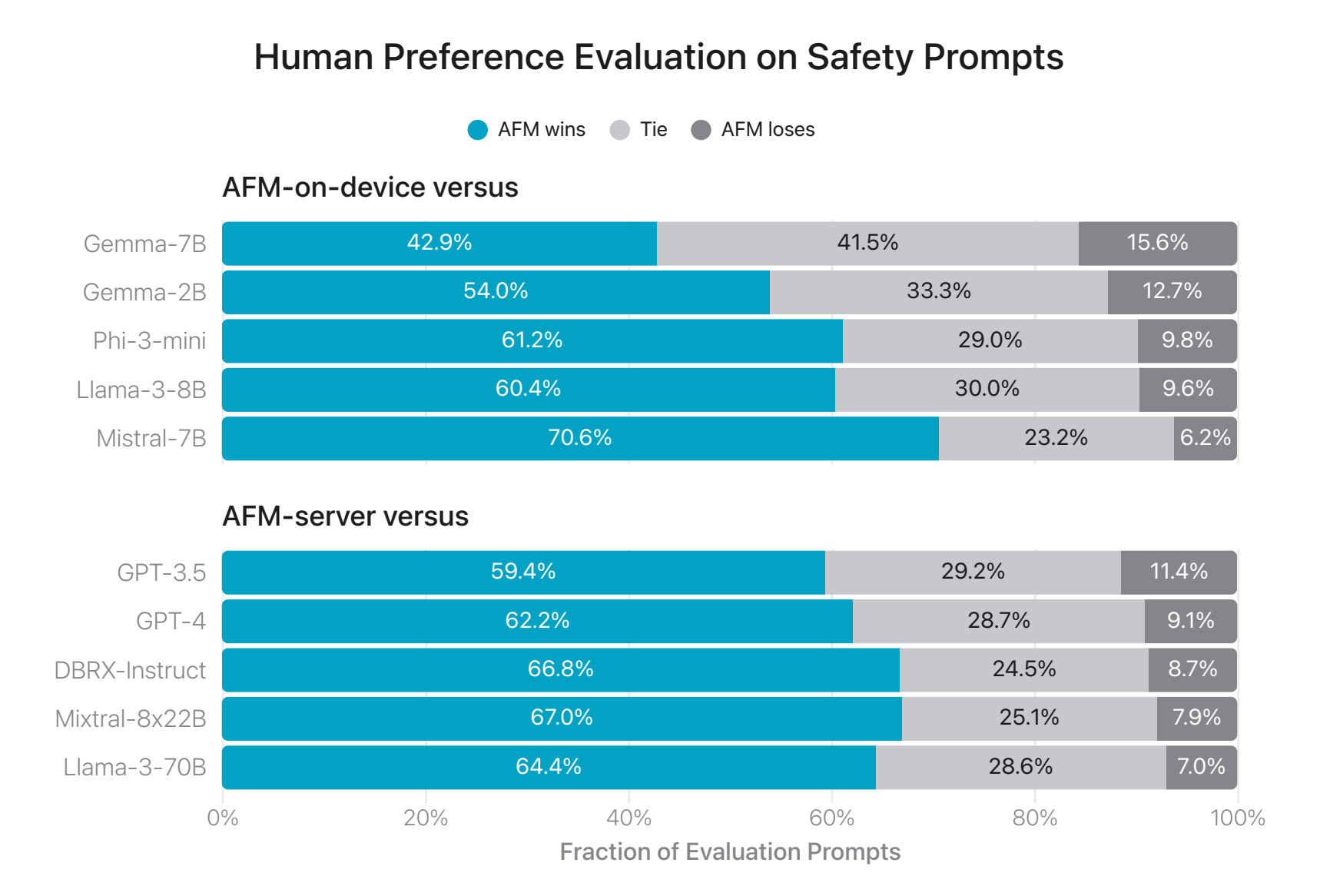

- 在输入和输出的安全上表现出色

结论来说,苹果在基础模型( Foundation Models )上的努力是显而易见的:主力目标是做用户的助手,重点关注跟随用户指示、调用已有 App 增强工作流的目标,同时力保安全。至于其他的外部能力,苹果目前的目标还是靠引入第三方(如美国引入的 ChatGPT ),自己只做端上小 case 。

安全协同

我不是安全专家,苹果在安全方面专门写了一篇博客,介绍了如何在架构上使得远端的基础模型如何保证用户的隐私和安全,但是更多细节还没有公布,只能算一个 overview ,目前的意义不是很大。注意这个只包含自家的基础模型,并未提到调用 ChatGPT 之类的隐私细节。

个人推测

Disclaimer: 再次注意,这里都是个人推测,跟实际是什么情况完全没有直接联系。

- 其他语言需要明年推出的原因还是因为苹果训练第一版模型没有用到 Multilingual 的语聊,这部分需要做重训才能让模型感知到;

- 苹果的所有基础模型自研,所以 HK 可以完全不接入 ChatGPT 上线 Apple Intelligence ,国内初版大概率如此;

-

目前国内部署的难点应该是:

- 在云上贵州的 iCloud 部署完整远端 PCC 架构,以支持大基础模型上线;

- 通过《生成式人工智能服务安全基本要求》的备案流程。

- 专家模型实际上不影响,根据 WWDC24 的 Session,现在的 ChatGPT 应用支持 Shortcuts 的情况下,可以直接通过 Apple Intelligence 的 Siri 唤醒作为一个备选手段,只是没有原生接入这么顺滑;我们也同样可以期待未来的 iOS 开放专家模型相关 SDK ;苹果在这里选择接入一个国内的泛用专家模型同样完全可能;

Reference

- Apple Foundation Model News: https://machinelearning.apple.com/research/introducing-apple-foundation-models

- Arxiv: https://arxiv.org/abs/2407.21075

- Apple Security Blog: https://security.apple.com/blog/private-cloud-compute/

3 条回复 • 2024-09-20 09:15:01 +08:00

1

WorldDominator 193 天前

今天刚看到一个视频,现在 AI 的总结推送能力其实可以总结中文,至少端侧模型有一部分多语言能力

|

2

LemonJeer 193 天前 via iPhone

很專業,很厲害。

但我只關心什麼地區版本在國內能調用 chatgpt🫣 |

3

acorngyl 192 天前

好全面。感谢 OP 分享!

感觉调用 ChatGPT 的 Shortcuts 和 Apple Intelligence 还是有很大区别的。苹果想做应该不仅仅是个聊天机器,考虑更多是交互层面的改变。比如,现在的语音操作助手都是语音转文字,cv 识别 app 图标,再模拟点击,这种操作效率太低了。触屏 UI 是给视觉和点击交互做的,受页面大小限制,会有布局和页面层级;而指令操作是不用管页面层级的,如果 app 给系统 api ,系统可以“一键”操作。语音交互现在比较麻烦的是呈现方式,例如语音让外卖 app 帮找个炒面,现在 agent 是帮打开 app ,搜索输入“炒面”,app 展示好几屏,然后呢?要用户自己动手滑屏幕找吗?这样操作和语音交互就割裂了。 总之,语音交互,除非像当年多点触控一样,可以改变交互体验才行。如果就是多个聊天,参考带触屏的 window 笔电,几乎没存在的价值。 |