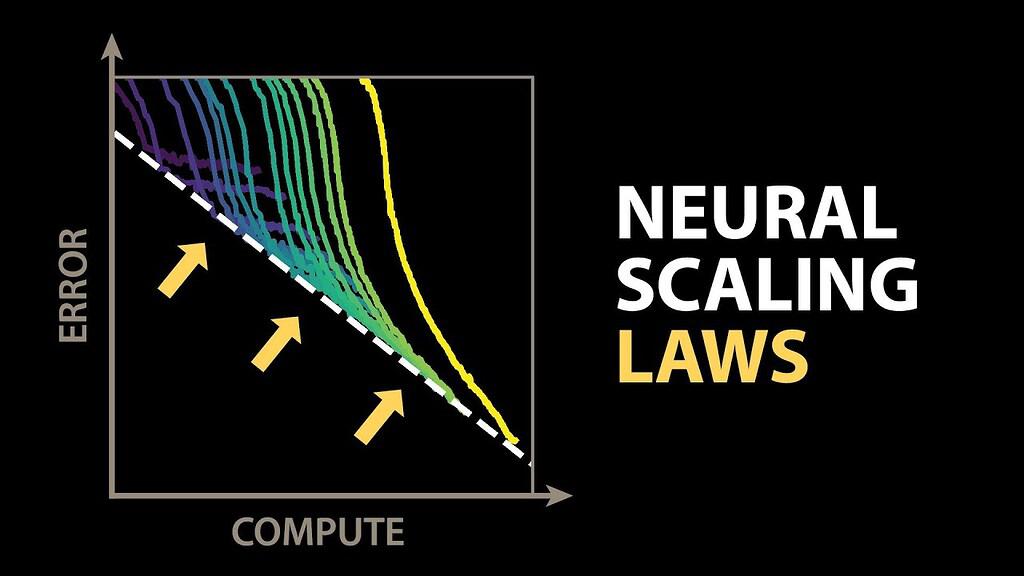

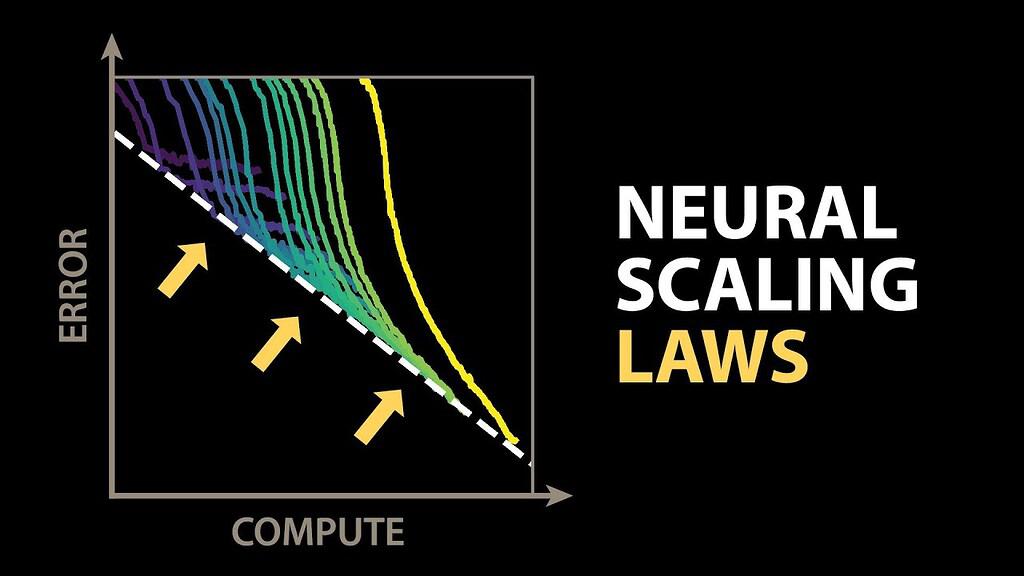

Scaling Law 的神奇在于,不只是预训练,甚至包括 RL 训练、推理时计算,都非常好的遵循 Scaling Law 。一个高中生就能根据它,准确预测未来模型的性能,只需要告诉他投入了多少算力!

这让我好奇,在当前,它到底有没有放缓,会不会放缓呢?因为这点决定了很多事情。

但即使对于这样简单的一个问题,也存在着矛盾的 2 面:一方面,大模型厂商的数据都是保密的,自 OpenAI 变成 CloseAI 后,似乎少有数据从它们内部发表出来;与之矛盾的另一方面,是这些大模型厂商又都在同一时段,取得了非常接近的成果!这是否说明,有某些信息其实是半公开的,有共识的,只不过没人主动揭开那层面纱?就比如现实世界的缩放定律能维持到什么时候这样一个基础的问题?

然后我开始了搜索,先是找到了 36kr 的这篇文章:( GPT-5 被吐槽没进步? Epoch 年终报告打脸:AI 在飞速狂飙,ASI 更近了)

https://eu.36kr.com/zh/p/3609407158404102

里面发现了这句关键,「 OpenAI 、Anthropic 在 2025 年初就曾表示,它们当前的 RL 扩展速度最多只能维持 1–2 年」!——吐槽下,这句话也恰好印证了大模型厂商的保密,连做 AI 的同行也不知道 RL 扩展时效这些基本的东西。

我每天都在关注 AI ,奇怪的是我听到的都是「没有墙」、「 Scaling Law 没有放缓,只是换了形式」,这个 1-2 年的说法从哪儿来的呢?

于是顺藤摸瓜,找到了这篇很有意思的文章: ( RL 缩放的效果如何?)

https://www.lesswrong.com/posts/xpj6KhDM9bJybdnEe/how-well-does-rl-scale

这个作者 Toby_Ord 真的很厉害,他用我们每天都能看到的模型 benchmark 图,就推算出了 RL 的效率相比预训练的效率的数量关系(这也是 Scaling law 的魅力所在)。然后他根据算力投入,得出了 RL 缩放在算力上不可持续的结论。真的是非常典型的人类「少样本学习」。

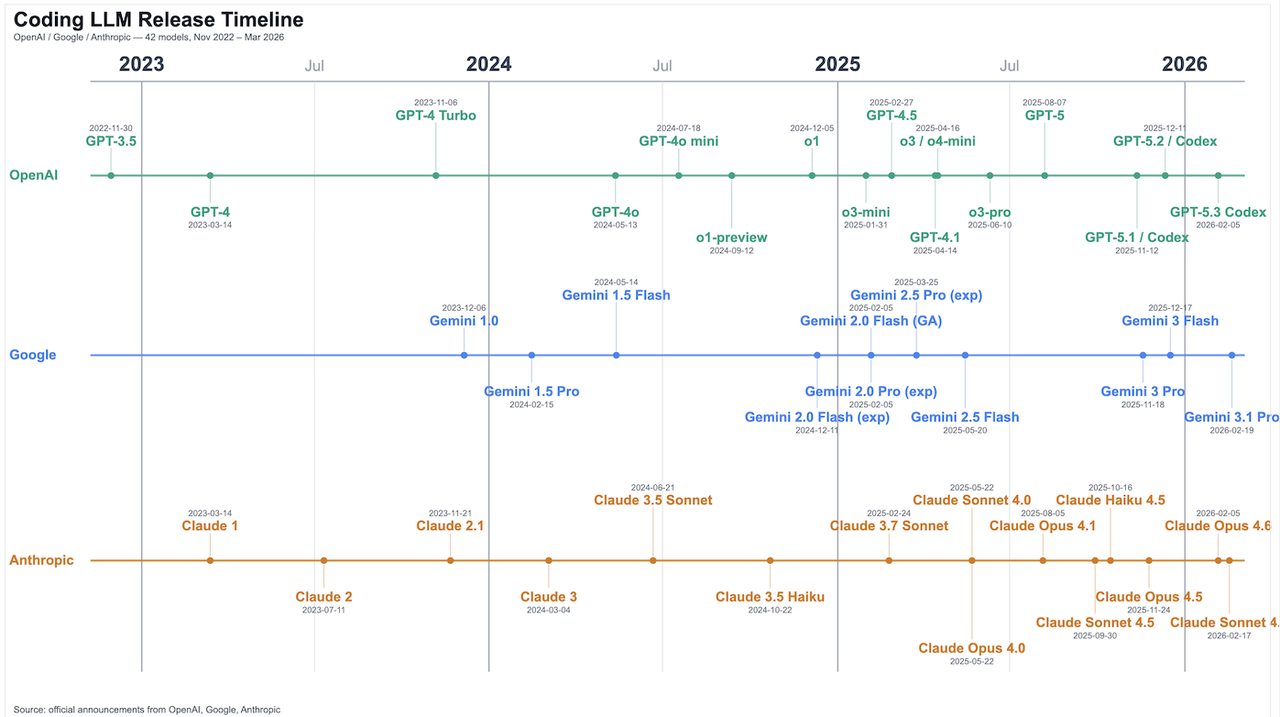

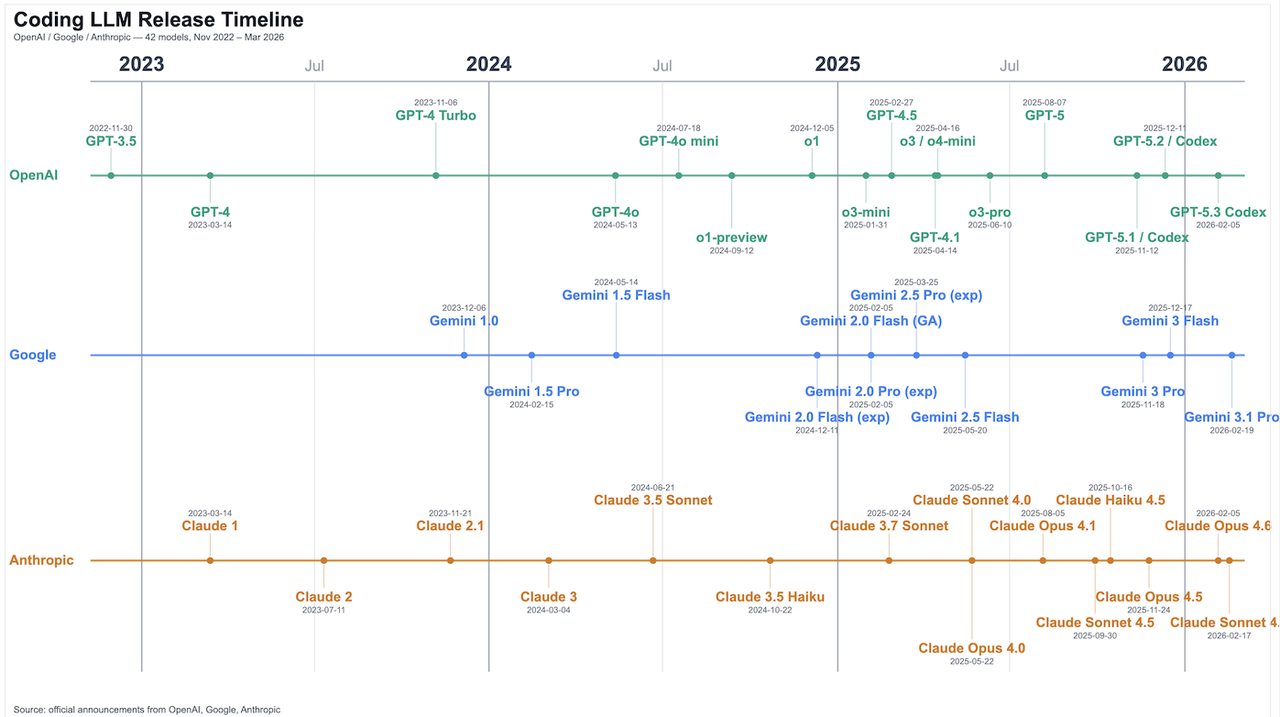

根据作者的分析,可以描绘出一个很简洁的关于大语言模型在缩放定律下发展的故事图景:2025 年是 RL 缩放辉煌的一年,而在这之前的 2024 年末,o1 模型,引爆了 RL 缩放,那时候,基于预训练的缩放,由于数据耗尽无法大规模扩张,陷入了困境,而 RL 缩放来得恰逢其时,每次将 10x 算力用于 RL 训练,都能获得稳步的性能提升,这与预训练的缩放情形何其类似!虽然 10x 算力用在 RL 训练上带来的提升,效率低些,不如用在预训练上的提升,但关键是起点不同,当时的预训练已经处在一个非常高的位置(比如每次训练花费动辄数十亿美元),再持续放大 10 倍是不可想象的,而 RL 训练还处在非常早期,意味着 10x 算力可能只相当于 100 万美元级别的投入,再 10x 也不过才 1000 万美元。Anthropic 的 CEO 阿莫代伊在 2025 年初说过,我们还处于 RL 缩放曲线非常早期的位置。这也是 2025 年大模型蓬勃发展的原因,每隔 3~4 个月,就有一个新版本的模型诞生。不过,一旦 RL 训练所需的算力追平预训练所需的算力,RL 缩放将无法再持续,它的效率甚至比预训练还低,根据 Toby_Ord 的计算,提升相同性能所需的算力倍数是预训练的平方。这也因应了「 RL 只能持续 1-2 年」的说法。

2026 年,似乎是缩放定律的一个关键时间节点。下面这张模型发布时间图,在 2026 年,会怎样变化呢?

上图中,最有意思的是 Claude 模型的命名:3.0, 3.5, 3.7, 4.0, 4.1, 4.5, 4.6 ,这些数字代表什么,是不是根据缩放定律取得的进步程度呢,间隔越大性能提升越高?它最近的模型发布时间间隔与命名编号,是不是证实了 RL 缩放在放缓呢?

这让我好奇,在当前,它到底有没有放缓,会不会放缓呢?因为这点决定了很多事情。

但即使对于这样简单的一个问题,也存在着矛盾的 2 面:一方面,大模型厂商的数据都是保密的,自 OpenAI 变成 CloseAI 后,似乎少有数据从它们内部发表出来;与之矛盾的另一方面,是这些大模型厂商又都在同一时段,取得了非常接近的成果!这是否说明,有某些信息其实是半公开的,有共识的,只不过没人主动揭开那层面纱?就比如现实世界的缩放定律能维持到什么时候这样一个基础的问题?

然后我开始了搜索,先是找到了 36kr 的这篇文章:( GPT-5 被吐槽没进步? Epoch 年终报告打脸:AI 在飞速狂飙,ASI 更近了)

https://eu.36kr.com/zh/p/3609407158404102

里面发现了这句关键,「 OpenAI 、Anthropic 在 2025 年初就曾表示,它们当前的 RL 扩展速度最多只能维持 1–2 年」!——吐槽下,这句话也恰好印证了大模型厂商的保密,连做 AI 的同行也不知道 RL 扩展时效这些基本的东西。

我每天都在关注 AI ,奇怪的是我听到的都是「没有墙」、「 Scaling Law 没有放缓,只是换了形式」,这个 1-2 年的说法从哪儿来的呢?

于是顺藤摸瓜,找到了这篇很有意思的文章: ( RL 缩放的效果如何?)

https://www.lesswrong.com/posts/xpj6KhDM9bJybdnEe/how-well-does-rl-scale

这个作者 Toby_Ord 真的很厉害,他用我们每天都能看到的模型 benchmark 图,就推算出了 RL 的效率相比预训练的效率的数量关系(这也是 Scaling law 的魅力所在)。然后他根据算力投入,得出了 RL 缩放在算力上不可持续的结论。真的是非常典型的人类「少样本学习」。

根据作者的分析,可以描绘出一个很简洁的关于大语言模型在缩放定律下发展的故事图景:2025 年是 RL 缩放辉煌的一年,而在这之前的 2024 年末,o1 模型,引爆了 RL 缩放,那时候,基于预训练的缩放,由于数据耗尽无法大规模扩张,陷入了困境,而 RL 缩放来得恰逢其时,每次将 10x 算力用于 RL 训练,都能获得稳步的性能提升,这与预训练的缩放情形何其类似!虽然 10x 算力用在 RL 训练上带来的提升,效率低些,不如用在预训练上的提升,但关键是起点不同,当时的预训练已经处在一个非常高的位置(比如每次训练花费动辄数十亿美元),再持续放大 10 倍是不可想象的,而 RL 训练还处在非常早期,意味着 10x 算力可能只相当于 100 万美元级别的投入,再 10x 也不过才 1000 万美元。Anthropic 的 CEO 阿莫代伊在 2025 年初说过,我们还处于 RL 缩放曲线非常早期的位置。这也是 2025 年大模型蓬勃发展的原因,每隔 3~4 个月,就有一个新版本的模型诞生。不过,一旦 RL 训练所需的算力追平预训练所需的算力,RL 缩放将无法再持续,它的效率甚至比预训练还低,根据 Toby_Ord 的计算,提升相同性能所需的算力倍数是预训练的平方。这也因应了「 RL 只能持续 1-2 年」的说法。

2026 年,似乎是缩放定律的一个关键时间节点。下面这张模型发布时间图,在 2026 年,会怎样变化呢?

上图中,最有意思的是 Claude 模型的命名:3.0, 3.5, 3.7, 4.0, 4.1, 4.5, 4.6 ,这些数字代表什么,是不是根据缩放定律取得的进步程度呢,间隔越大性能提升越高?它最近的模型发布时间间隔与命名编号,是不是证实了 RL 缩放在放缓呢?

1

JoeJoeJoe PRO 感谢分享干货!

我突然发现一个很严重的问题, 因为用 AI 分析成为习惯了, 现在看到这些复杂数据对比或者文字密集的时候, 我会下意识的规避或者逃避, 想让 AI 来帮我总结一下. 幸亏看 op 这个帖子突然醒悟, 再次感谢 op! |

2

sillydaddy OP @JoeJoeJoe 搜集资料时,我也问了 AI ,😂

|

3

thinszx 5 天前

看这张图,25 年模型侧真的发生太多事了

|

4

iloveoovx 5 天前

宏观来看一定会找到新方法,本来这么高的投入,对于木桶短板会更敏感;就像为啥上来猛搞数据因为那时数据肯定更容易搞,数据提量提质效果收益明显;数据搞差不多了就只好在没那么直接的训练上想办法。之后到一定程度了又会回数据的,就像练武的会去找葵花宝典。当然训练的花活还有很多空间,没必要盯死觉得 rl 决定一切

|

5

sillydaddy OP @iloveoovx 一旦 RL 缩放放缓,虽然还有其他优化空间,但是会直接影响 scaling 的速度。

另外,我发这个,也是说明我对这些 AI 公司很不信任:连这些基本的信息,他们都不会放出来,比如我们的 RL 缩放还能支持多长时间之类的话。从我发的主题里面的评论可以知道,大家基本都靠猜。 如果这么基本的无害的信息,他们都要闭嘴不提,我根本不能相信这些 AI 公司能有什么透明度和操守。话倒是都说得很漂亮。 |

6

iloveoovx 5 天前

你这话说得,entitlement 大了点吧。什么叫无害?因为很多人误会然后大嚷大叫说 AI 进步到头了损伤股价叫不叫无害?何况是这种置信度很低的单维度指标 - 他们最多根据现在的情况估计下 rl 能带来多久值当的 loss 下降收益,但和最终用户的满意程度之间的关系,随着各种策略切入只会越来越低,在学术界层出不穷的思路优化中,他们自己也不可能知道是否会有调整以及如何调整,怎么给你一个让你满意的答案呢?这可是在造上帝;你把这单一维度看得比天高,并认为那些 AI 公司已经知道一切,说明你把概念抓得太紧,被逻辑理性概念洗脑有点深,不开玩笑建议去学点灵性神学对冲下

|

7

sillydaddy OP @iloveoovx

你这逻辑跳跃的,确实该补点逻辑,而不是脑补什么「一听到 RL 缩放还能持续 1 年,就发生误会,损伤了股价」,你后面不也说了学术界有层出不穷的优化思路吗? 另外,现实不就是 RL 缩放主导了缩放定律吗,主题里也提到了,缩放的方式改变了。怎么在你这里就成了置信度很低的单维度指标。 关于 AI 公司的责任,考虑到我没有给你足够的上下文,我来补充一下,以免你产生幻觉。 首先这个责任这不是我强加给它们的,所有 AI 公司都在说公共责任,特别是 Anthropic 。你可以看看他们出席多少公共论坛、接受多少公共采访,畅谈他们对 AI 的发展判断,去看看阿莫代伊的博客,里面「仁慈的机器」都出来了。 然后你知道什么是 AI 发展中最重要的吗,不是别的,恰恰是 Scaling Law ,没有之一。谈 AI 发展的前提,就是谈缩放定律,而我说的 RL 缩放的时效,恰恰包含在里面,它还是一个核心。 考虑到上面的 2 点上下文,你再去分析一下他们公开的发言,通篇都是多少年实现 AGI ,对未来的影响,但这些务实的缩放定律时效,他们丝毫不涉及!这个时效,是一个客观的东西,不是你说的用户满意度,它受限于客观的算力。你觉得,他们在面对投资人的时候,也会像面向公众的时候,大谈 AGI 大谈它们的进步,却对这些时效问题闭口不谈吗?这种态度的区别,说明了什么呢?你的道德标准可能比较低,认为这没有什么问题。我的标准跟你不一样。 另外我上面的回复也没有针对你啊,你这刻薄的毛病从哪儿来的。 |

8

iloveoovx 2 天前

嗯?不是,你这理解能力,我说的是如果他们只是简单直白把你心中认为的这个绝对标准定性定量公布,包括各种标题党媒体在内的很多人会这么传播,什么时候说过是我的理解了?还是你觉得这种事不会发生?那你只能是太自我为中心的视角了,认为世界上其他人都和你一样,导致完全忽略这种显而易见的事情走向到误解我那句话的程度

然后,你所谓的这个责任和 Scaling Law 的关系在哪?不被 AI 统治?还是避免滥用?甚至世界大同?如果你不能完备定义这个责任,那他们欠你啥了?是,他们发报告,发愿景,发实验结果风险预测,但是不好意思,我不觉得他们是上帝,能定出一个让大家满意又反应现实的绝对标尺,如果世界能被逻辑完备定义早大同了 - 所以在所谓的责任层面我不认为他们道德低,因为我看不到更好的解决方案 然后是 Scaling Law ,凭什么你认为这个是最重要的指标别人就认啊。没错,这是对模型性能很聪明的一个抽象衡量的方式,但哪怕温度计测体温的数字你就认为反应所有现实了?而且说到底 scaling law 面对的就是 loss 下降,但这个 loss 是谁定义的?还不是来源于人的认知?训练数据集不就是人类抽象到语言层的集体意识集合? RL 训练的过程不也是基于人类监督反馈?所以这里数据来自于人,训练过程用人类的意图监督,最终人也要用得满意。到这一步就出现偏差了,loss 更低的模型,一定会让用户更满意吗?以及同一个模型,用户满意度和 loss 下降程度是线性关系吗?那国产 model 出来都吊打各路 benchmark ,就像国产手机参数永远吊打 iPhone 一样。用屁股想想也知道了吧,你觉得像素越高照片就是更好的吗?处理器频率更高就是更好吗? 我做过小米发布会,看到被人嘲笑的小字确实挺烦的,但是看来没办法,再怎么说你们世界观里就只有这套。如此高维度的问题,你只抓一个维度还认为是最重要的,在这基础上就认为别人也得认为这是重要的 - 尤其是还强行要求别人基于此预测现实,不预测就是耍流氓,拜托,哪怕退一万步所有人都认 scaling law 的重要,但现在别人远一点记得 IBM 董事长说世界上只需要五台计算机的事,近一点记得无数业内人士预测摩尔定律即将失效然后永远被打脸的事,谁没事找事在这个进展最快变化最大的领域里去接你这个无妄之锅啊。 我这“刻薄”的来源很简单,为了对 AI 的了解不仅仅停留在打脑力飞机的层面,也练内观观察自己思维过程去映射到模型原理过程,练多了对 entitlement ,局限视角,逻辑缺陷的视角很敏感,而不是对人对事的立场。很多局限视角很普遍,看多了就特别显眼,你这上升到道德就是典型的标志。先觉得别人欠你一个乌托邦 AGI 的未来,然后找到了一个指标就认为可被衡量的数据最重要,其他都是“虚话”,把自己的视角强加到外界,非认为这个指标天经地义,然后要求别人预言未来不预言就是道德低,态度不对。真就连说不定别人根本没多在意这一点的可能性都不去管。 |

9

sillydaddy OP @iloveoovx 长篇大论的废话!其实就是在以一种绝对主义的方式,一直在否定贬低 RL 缩放,乃至 Scaling Law 。

我基于现实说话,你在那里意淫。我说 RL 缩放放缓的可能性,你说还有一万种提升的可能性。我从始至终也没否定这一万种可能性啊。你能理解这里面的差别吗? 意淫谁不会啊,你要是有其他的证据,就拿出来,比如说「 2025 年不是 RL 缩放在主导模型的提升」,也算我涨个见识,拿「凭什么你认为这个是最重要的指标别人就认啊」、「退一万步所有人都认 scaling law 的重要,别忘了五台计算机的事」这种逻辑不清的指控,我也懒得跟你辩了, |