这是一个创建于 500 天前的主题,其中的信息可能已经有所发展或是发生改变。

1

jhdxr 2024-05-15 05:46:00 +08:00

说的好像现在有高质量中文语料来源一样的。

本身简体中文(可公开访问的)内容就少,墙内网站还在纷纷对海外 IP 建墙,爬到的内容全是垃圾岂是并不奇怪。 对于大陆的炼丹师来说这个问题当然是致命的,但反正 openai 和大陆早就双向奔 ping 赴 bi 了,所以也没啥问题? |

2

wangyaominde 2024-05-15 14:12:14 +08:00

这好像说明不了什么,这类词在 ChatGPT 里面的权重也看不到,调用分词器输出就跟查词典直接让他输出一样

|

3

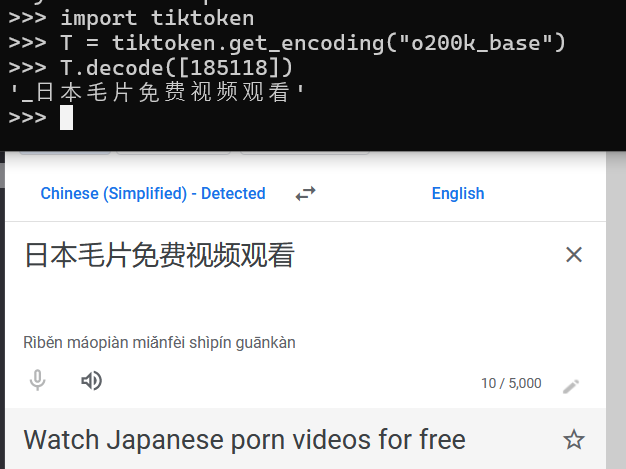

Xs0ul OP 上面两个链接都给了例子,因为这些 token 没被合理地分词,并且在训练数据里也很难被训练到,会导致 chatgpt 在遇到这些词的时候输出无关或者无意义的回答,例如 https://twitter.com/HanchungLee/status/1790273097188393391

|